Typ: Content

Originaler Link: https://x.com/varchasvee_/status/1986811191474401773?s=43&t=ANuJI-IuN5rdsaLueycEbA

Veröffentlichungsdatum: 2025-11-12

Zusammenfassung #

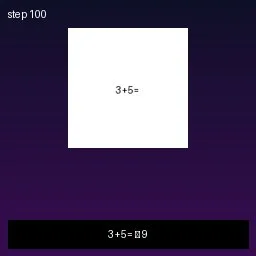

WAS - Ein Twitter-Post, der die Entfernung von Tokenisierern in optischen Zeichenerkennungsmodellen (OCR) diskutiert, basierend auf einem Beitrag von Andrej Karpathy.

WARUM - Relevant für das AI-Geschäft, da es einen innovativen Ansatz zur Verbesserung der Effizienz und Genauigkeit von OCR-Modellen vorschlägt, ohne die Notwendigkeit der Tokenisierung.

WER - Andrej Karpathy (Autor des ursprünglichen Beitrags), Varun Sharma (Autor des Tweets), Community von Entwicklern und AI-Forschern.

WO - Positioniert im Kontext der technischen Diskussion über OCR und NLP innerhalb der AI-Community auf Twitter.

WANN - Der Tweet wurde am 2024-05-16 veröffentlicht und spiegelt einen aktuellen Trend der Innovation in OCR-Modellen wider.

GESCHÄFTLICHE AUSWIRKUNGEN:

- Chancen: Die Entwicklung von OCR-Modellen ohne Tokenisierer kann die Komplexität reduzieren und die Genauigkeit verbessern, wodurch ein Wettbewerbsvorteil entsteht.

- Risiken: Der Übergang könnte erhebliche Investitionen in Forschung und Entwicklung erfordern.

- Integration: Mögliche Integration mit bestehenden OCR-Tools zur Testung und Validierung des Ansatzes ohne Tokenisierer.

TECHNISCHE ZUSAMMENFASSUNG:

- Kern-Technologiestack: OCR-Modelle, die Text direkt aus Pixeln lesen, ohne Tokenisierung.

- Skalierbarkeit und Grenzen: Die Skalierbarkeit hängt von der Fähigkeit des Modells ab, verschiedene Auflösungen und Textarten zu verarbeiten. Die Grenzen umfassen die Notwendigkeit großer Datensätze für das Training.

- Technische Differenzierer: Entfernung der Tokenisierung, Reduzierung der Modellkomplexität, potenzielle Verbesserung der Genauigkeit.

Anwendungsfälle #

- Private AI Stack: Integration in proprietäre Pipelines

- Client Solutions: Implementierung für Kundenprojekte

- Strategische Intelligenz: Input für technologische Roadmaps

- Wettbewerbsanalyse: Überwachung des AI-Ökosystems

Ressourcen #

Original Links #

- said we should delete tokenizers - Original Link

Artikel empfohlen und ausgewählt vom Human Technology eXcellence Team, erstellt mit KI (in diesem Fall mit LLM HTX-EU-Mistral3.1Small) am 2025-11-12 17:59 Quelle: https://x.com/varchasvee_/status/1986811191474401773?s=43&t=ANuJI-IuN5rdsaLueycEbA

Die HTX-Perspektive #

Dieses Thema steht im Mittelpunkt dessen, was wir bei HTX entwickeln. Die hier diskutierte Technologie — ob KI-Agenten, Sprachmodelle oder Dokumentenverarbeitung — repräsentiert genau die Art von Fähigkeiten, die europäische Unternehmen benötigen, aber zu ihren eigenen Bedingungen eingesetzt.

Die Herausforderung ist nicht, ob diese Technologie funktioniert. Das tut sie. Die Herausforderung ist, sie einzusetzen, ohne Unternehmensdaten an US-Server zu senden, ohne die DSGVO zu verletzen und ohne Lieferantenabhängigkeiten zu schaffen.

Deshalb haben wir ORCA entwickelt — einen privaten Unternehmens-Chatbot, der diese Fähigkeiten auf Ihre Infrastruktur bringt. Gleiche Leistung wie ChatGPT, aber Ihre Daten verlassen nie Ihren Perimeter.

Möchten Sie wissen, ob Ihr Unternehmen bereit für KI ist? Machen Sie unser kostenloses Assessment — 5 Minuten, personalisierter Bericht, umsetzbare Roadmap.

Verwandte Artikel #

- Mir gefällt der neue DeepSeek-OCR-Paper ganz gut. - Foundation Model, Go, Computer Vision

- Schön - mein Vortrag über meine AI-Startup-Schule ist jetzt online! Kapitel: 0:00 Es ist wohl fair zu sagen, dass sich Software wieder grundlegend verändert. - LLM, AI

- Schön - mein Vortrag über meine KI-Startup-Schule ist jetzt online! - LLM, AI

FAQ

Können große Sprachmodelle auf privater Infrastruktur laufen?

Ja. Open-Source-Modelle wie LLaMA, Mistral, DeepSeek und Qwen können On-Premise oder auf europäischer Cloud laufen. Diese Modelle erreichen eine mit GPT-4 vergleichbare Leistung für die meisten Geschäftsaufgaben, mit dem Vorteil vollständiger Datensouveränität.

Welches LLM ist am besten für den geschäftlichen Einsatz?

Das beste Modell hängt von Ihrem Anwendungsfall ab. Für Dokumentenanalyse und Chat zeichnen sich Mistral und LLaMA aus. Für Datenanalyse bietet DeepSeek starkes Reasoning. HTX's Ansatz ist modell-agnostisch: ORCA unterstützt mehrere Modelle.