Typ: GitHub Repository

Original Link: https://github.com/HKUDS/AI-Researcher

Veröffentlichungsdatum: 2025-09-24

Zusammenfassung #

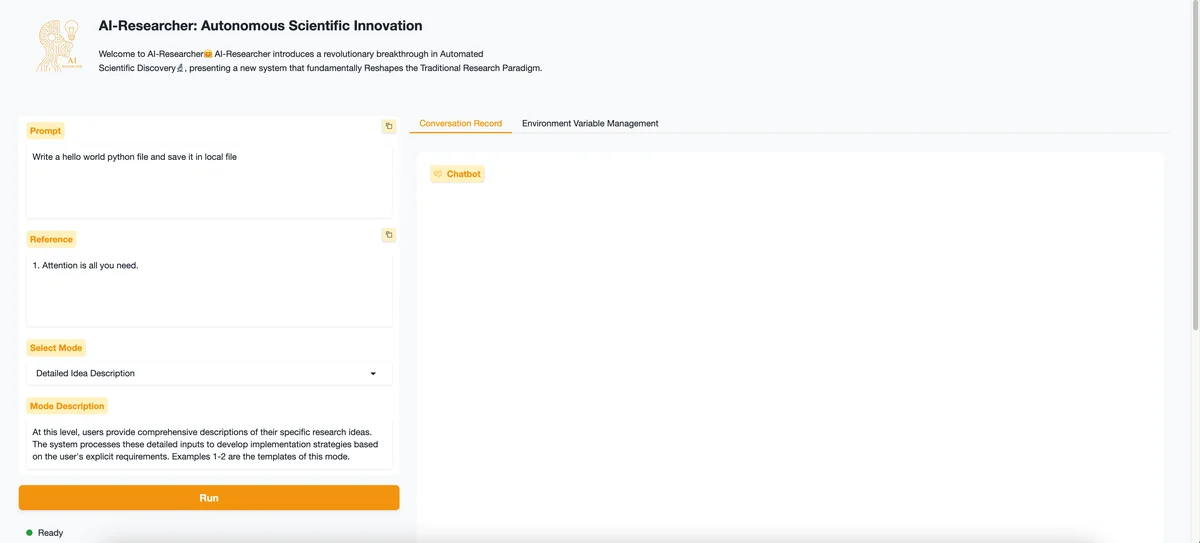

WAS - AI-Researcher ist ein autonomes wissenschaftliches Forschungssystem, das den Forschungsprozess von der Konzeptentwicklung bis zur Veröffentlichung automatisiert und fortschrittliche KI-Agenten integriert, um die wissenschaftliche Innovation zu beschleunigen.

WARUM - Es ist für das AI-Geschäft relevant, weil es die wissenschaftliche Forschung vollständig automatisieren kann, wodurch die Zeit und Kosten für die Entdeckung und Veröffentlichung neuer Erkenntnisse reduziert werden.

WER - Die Hauptakteure sind HKUDS (Hong Kong University of Science and Technology Department of Systems Engineering and Engineering Management) und die Entwicklergemeinschaft, die zum Projekt beiträgt.

WO - Es positioniert sich im Markt der AI-Lösungen für wissenschaftliche Forschung und bietet ein vollständiges Ökosystem für die Automatisierung der Forschung.

WANN - Es ist ein relativ neues Projekt, das auf der NeurIPS 2025 vorgestellt wurde, aber bereits in einer produktionsbereiten Version vorliegt, was auf eine schnelle Entwicklung und Adoption hinweist.

GESCHÄFTLICHE AUSWIRKUNGEN:

- Chancen: Automatisierung der wissenschaftlichen Forschung zur Beschleunigung der Produktion von Veröffentlichungen und Patenten.

- Risiken: Wettbewerb mit anderen automatisierten Forschungsplattformen und Abhängigkeit von externen AI-Modellen.

- Integration: Mögliche Integration mit Forschungsmanagement-Tools und wissenschaftlichen Veröffentlichungsplattformen.

TECHNISCHE ZUSAMMENFASSUNG:

- Kerntechnologiestack: Python, Docker, Litellm, Google Gemini-2.5, GPU-Unterstützung.

- Skalierbarkeit: Verwendet Docker für das Container-Management, was horizontale Skalierbarkeit ermöglicht. Architekturbezogene Grenzen können die Verwaltung großer Datenmengen und die Abhängigkeit von externen APIs umfassen.

- Technische Differenzierer: Vollständige Autonomie, nahtlose Orchestrierung, fortschrittliche AI-Integration und Forschungsbeschleunigung.

NÜTZLICHE DETAILS:

- Verwendete AI-Modelle: Google Gemini-2.5

- Hardware-Konfiguration: Unterstützung für spezifische GPUs, konfigurierbar für den Multi-GPU-Einsatz.

- APIs und Integrationen: Verwendet OpenRouter API für den Zugriff auf Abschluss- und Chat-Modelle.

- Dokumentation und Support: Vorhandene detaillierte Dokumentation und aktive Community auf Slack und Discord.

Anwendungsfälle #

- Private AI Stack: Integration in proprietäre Pipelines

- Client Solutions: Implementierung für Kundenprojekte

- Development Acceleration: Reduzierung der Time-to-Market für Projekte

- Strategische Intelligenz: Input für technologische Roadmaps

- Wettbewerbsanalyse: Überwachung des AI-Ökosystems

Ressourcen #

Original Links #

- AI-Researcher: Autonomous Scientific Innovation - Original Link

Artikel empfohlen und ausgewählt vom Human Technology eXcellence Team, erstellt mit KI (in diesem Fall mit LLM HTX-EU-Mistral3.1Small) am 2025-09-24 07:35 Originalquelle: https://github.com/HKUDS/AI-Researcher

Die HTX-Perspektive #

Dieses Thema steht im Mittelpunkt dessen, was wir bei HTX entwickeln. Die hier diskutierte Technologie — ob KI-Agenten, Sprachmodelle oder Dokumentenverarbeitung — repräsentiert genau die Art von Fähigkeiten, die europäische Unternehmen benötigen, aber zu ihren eigenen Bedingungen eingesetzt.

Die Herausforderung ist nicht, ob diese Technologie funktioniert. Das tut sie. Die Herausforderung ist, sie einzusetzen, ohne Unternehmensdaten an US-Server zu senden, ohne die DSGVO zu verletzen und ohne Lieferantenabhängigkeiten zu schaffen.

Deshalb haben wir ORCA entwickelt — einen privaten Unternehmens-Chatbot, der diese Fähigkeiten auf Ihre Infrastruktur bringt. Gleiche Leistung wie ChatGPT, aber Ihre Daten verlassen nie Ihren Perimeter.

Möchten Sie wissen, ob Ihr Unternehmen bereit für KI ist? Machen Sie unser kostenloses Assessment — 5 Minuten, personalisierter Bericht, umsetzbare Roadmap.

Verwandte Artikel #

- NextChat - AI, Open Source, Typescript

- FutureHouse Plattform - AI, AI Agent

- Tiefes Gespräch - Typescript, Open Source, AI

FAQ

Können Open-Source-KI-Tools sicher im Unternehmen eingesetzt werden?

Absolut. Open-Source-Modelle wie LLaMA, Mistral und DeepSeek sind produktionsreif und werden von großen Unternehmen eingesetzt. Der Schlüssel ist die richtige Bereitstellung: Sie auf Ihrer eigenen Infrastruktur laufen zu lassen, gewährleistet Datenschutz und DSGVO-Konformität.

Was ist der Vorteil von Open-Source-KI gegenüber proprietären Lösungen?

Open-Source-KI bietet drei zentrale Vorteile: kein Vendor Lock-in, volle Transparenz über die Funktionsweise des Modells und die Möglichkeit, vollständig auf Ihrer Infrastruktur zu laufen.