Tipo: Contenido Enlace original: https://x.com/varchasvee_/status/1986811191474401773?s=43&t=ANuJI-IuN5rdsaLueycEbA Fecha de publicación: 2025-11-12

Resumen #

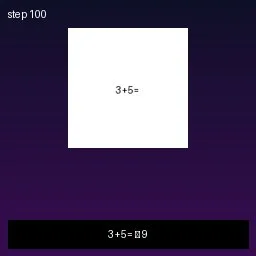

QUÉ - Un post en Twitter que discute la eliminación de los tokenizadores en los modelos de reconocimiento óptico de caracteres (OCR), basado en un post de Andrej Karpathy.

POR QUÉ - Relevante para el negocio de IA porque sugiere un enfoque innovador para mejorar la eficiencia y la precisión de los modelos OCR, eliminando la necesidad de tokenización.

QUIÉN - Andrej Karpathy (autor del post original), Varun Sharma (autor del tweet), comunidad de desarrolladores e investigadores de IA.

DÓNDE - Posicionado en el contexto del debate técnico sobre OCR y NLP, dentro de la comunidad de IA en Twitter.

CUÁNDO - El tweet fue publicado el 2024-05-16, reflejando una tendencia actual de innovación en los modelos de OCR.

IMPACTO EN EL NEGOCIO:

- Oportunidades: Desarrollar modelos OCR sin tokenizadores puede reducir la complejidad y mejorar la precisión, ofreciendo una ventaja competitiva.

- Riesgos: La transición podría requerir inversiones significativas en investigación y desarrollo.

- Integración: Posible integración con herramientas de OCR existentes para probar y validar el enfoque sin tokenizadores.

RESUMEN TÉCNICO:

- Pila tecnológica principal: Modelos de OCR que leen texto directamente de los píxeles, omitiendo la tokenización.

- Escalabilidad y limitaciones: La escalabilidad depende de la capacidad del modelo para manejar diferentes resoluciones y tipos de texto. Las limitaciones incluyen la necesidad de grandes conjuntos de datos para el entrenamiento.

- Diferenciadores técnicos: Eliminación de la tokenización, reducción de la complejidad del modelo, posible mejora de la precisión.

Casos de uso #

- Private AI Stack: Integración en pipelines propietarias

- Soluciones para clientes: Implementación para proyectos de clientes

- Inteligencia estratégica: Entrada para la hoja de ruta tecnológica

- Análisis competitivo: Monitoreo del ecosistema de IA

Recursos #

Enlaces originales #

- said we should delete tokenizers - Enlace original

Artículo recomendado y seleccionado por el equipo Human Technology eXcellence elaborado mediante inteligencia artificial (en este caso con LLM HTX-EU-Mistral3.1Small) el 2025-11-12 17:59 Fuente original: https://x.com/varchasvee_/status/1986811191474401773?s=43&t=ANuJI-IuN5rdsaLueycEbA

Artículos relacionados #

- 🚀 Hello, Kimi K2 Thinking! The Open-Source Thinking Agent Model is here - Natural Language Processing, AI Agent, Foundation Model

- I quite like the new DeepSeek-OCR paper - Foundation Model, Go, Computer Vision

- We used DeepSeek OCR to extract every dataset from tables/charts ac… - AI

Artículos Relacionados #

- Utilizamos DeepSeek OCR para extraer cada conjunto de datos de tablas/gráficos ac… - AI

- ¡Hola, Kimi K2 Thinking! ¡El Modelo de Agente de Pensamiento de Código Abierto está aquí! - Natural Language Processing, AI Agent, Foundation Model

- DeepSeek OCR - Más que OCR - YouTube - Image Generation, Natural Language Processing