Tipo: Repositorio de GitHub

Enlace original: https://github.com/rasbt/LLMs-from-scratch

Fecha de publicación: 2025-09-04

Resumen #

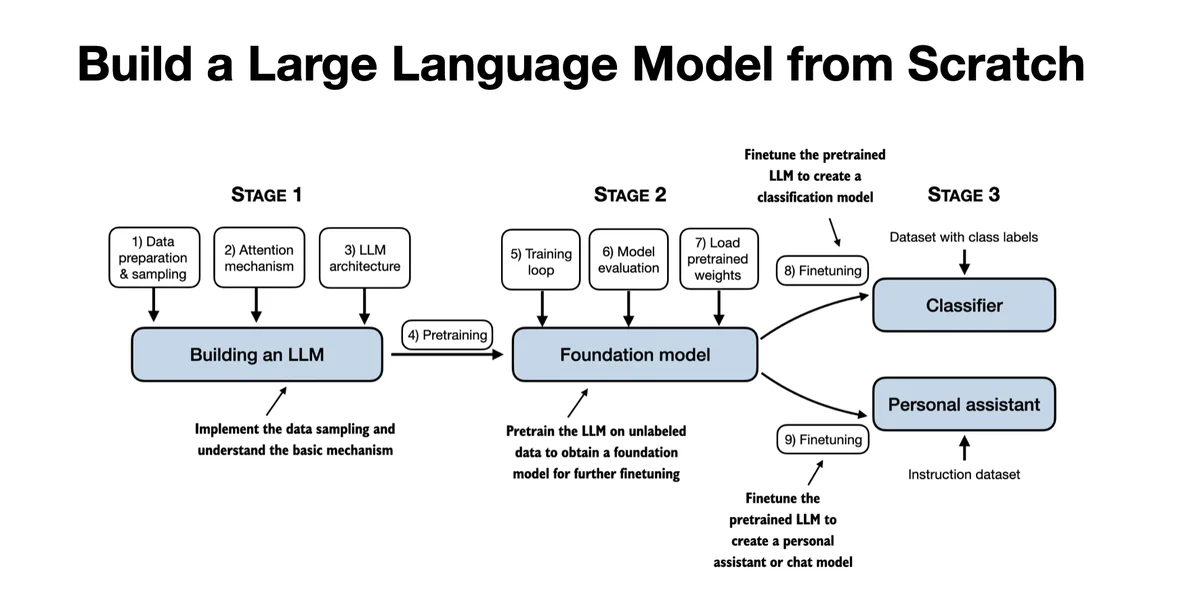

QUÉ - Este es un repositorio de GitHub que contiene el código para desarrollar, preentrenar y ajustar un modelo de lenguaje de gran tamaño (LLM) similar a ChatGPT, escrito en PyTorch. Es el código oficial para el libro “Build a Large Language Model (From Scratch)” de Manning.

POR QUÉ - Es relevante para el negocio de IA porque proporciona una guía detallada y práctica para construir y comprender los LLMs, permitiendo replicar y adaptar técnicas avanzadas de procesamiento del lenguaje natural. Esto puede acelerar el desarrollo de modelos personalizados y mejorar la competencia interna.

QUIÉNES - Los actores principales son Sebastian Raschka (autor del libro y del repositorio), Manning Publications (editor del libro) y la comunidad de desarrolladores en GitHub que contribuyen y utilizan el repositorio.

DÓNDE - Se posiciona en el mercado de la educación y el desarrollo de LLMs, ofreciendo recursos prácticos para quienes desean construir modelos de lenguaje avanzados. Es parte del ecosistema de PyTorch y se dirige a desarrolladores e investigadores interesados en LLMs.

CUÁNDO - El repositorio está activo y en constante evolución, con actualizaciones regulares. Es un proyecto consolidado pero en crecimiento, reflejando las tendencias actuales en el desarrollo de LLMs.

IMPACTO EN EL NEGOCIO:

- Oportunidades: Acelerar el desarrollo de modelos de lenguaje personalizados, mejorar la competencia interna y reducir los costos de formación.

- Riesgos: Dependencia de un solo repositorio para la formación, riesgo de obsolescencia si no se actualiza regularmente.

- Integración: Puede integrarse en el stack de desarrollo de IA existente, utilizando PyTorch y otras tecnologías mencionadas en el repositorio.

RESUMEN TÉCNICO:

- Tecnología principal: PyTorch, Python, Jupyter Notebooks y varios frameworks de procesamiento del lenguaje natural.

- Escalabilidad: El repositorio está diseñado para la educación y la prototipación, no para la escalabilidad industrial. Sin embargo, las técnicas pueden escalarse utilizando infraestructuras en la nube.

- Diferenciadores técnicos: Implementación detallada de mecanismos de atención, preentrenamiento y ajuste fino, con ejemplos prácticos y soluciones a los ejercicios.

Casos de uso #

- Stack de IA Privado: Integración en pipelines propietarias

- Soluciones para Clientes: Implementación para proyectos de clientes

- Aceleración del Desarrollo: Reducción del tiempo de comercialización de proyectos

- Inteligencia Estratégica: Entrada para la hoja de ruta tecnológica

- Análisis Competitivo: Monitoreo del ecosistema de IA

Feedback de terceros #

Feedback de la comunidad: Los usuarios valoran las recursos compartidos para construir y comprender modelos de lenguaje, con un consenso general sobre la utilidad de las guías e implementaciones. Las principales preocupaciones se refieren a la complejidad y accesibilidad de las técnicas de ajuste fino, con solicitudes de más tutoriales específicos para tareas de procesamiento del lenguaje natural.

Recursos #

Enlaces Originales #

- Build a Large Language Model (From Scratch) - Enlace original

Artículo recomendado y seleccionado por el equipo Human Technology eXcellence elaborado mediante inteligencia artificial (en este caso con LLM HTX-EU-Mistral3.1Small) el 2025-09-04 19:22 Fuente original: https://github.com/rasbt/LLMs-from-scratch

Artículos Relacionados #

- Presentando Qwen3-Max-Preview (Instruct) - AI, Foundation Model

- Una Implementación Paso a Paso de la Arquitectura Qwen 3 MoE desde Cero - Open Source

- Agentes de Modelos de Lenguaje Grande CS294/194-196 | Agentes de Modelos de Lenguaje Grande CS 194/294-196 - AI Agent, Foundation Model, LLM