Tipo: Repositorio de GitHub

Enlace original: https://github.com/FareedKhan-dev/qwen3-MoE-from-scratch

Fecha de publicación: 2025-09-20

Resumen #

QUÉ - Este es un tutorial que guía la construcción de un modelo Qwen 3 MoE (Mixture-of-Experts) desde cero, utilizando Jupyter Notebook. El tutorial se basa en un artículo de Medium e incluye un repositorio de GitHub con código y recursos adicionales.

POR QUÉ - Es relevante para el negocio de la IA porque proporciona una guía práctica para implementar un modelo avanzado de LLM (Large Language Model) que puede ser utilizado para mejorar las capacidades de procesamiento del lenguaje natural. Esto puede llevar a soluciones más eficientes y especializadas para aplicaciones de IA.

QUIÉN - Los actores principales incluyen a Fareed Khan, autor del tutorial, y Alibaba, que desarrolló el modelo Qwen 3. La comunidad de desarrolladores e investigadores de IA es el público principal.

DÓNDE - Se posiciona en el mercado educativo de la IA, ofreciendo recursos para el desarrollo de modelos avanzados de LLM. Es parte del ecosistema de herramientas de código abierto para la IA.

CUÁNDO - El tutorial fue publicado en 2025, lo que indica que se basa en tecnologías recientes y avanzadas. La madurez del contenido está relacionada con la difusión y adopción del modelo Qwen 3.

IMPACTO EN EL NEGOCIO:

- Oportunidades: Implementar modelos MoE puede mejorar la eficiencia y especialización de las soluciones de IA, ofreciendo una ventaja competitiva.

- Riesgos: La dependencia de tecnologías de código abierto puede conllevar riesgos relacionados con el mantenimiento y la actualización del código.

- Integración: El tutorial puede ser utilizado para capacitar al equipo de desarrollo interno, integrando los conocimientos adquiridos en el stack tecnológico existente.

RESUMEN TÉCNICO:

- Pila tecnológica principal: Jupyter Notebook, Python, PyTorch, Hugging Face Hub, sentencepiece, tiktoken, torch, matplotlib, tokenizers, safetensors.

- Escalabilidad y límites arquitectónicos: El modelo descrito tiene 0.8 mil millones de parámetros, mucho menos que los 235 mil millones del modelo original Qwen 3. Esto lo hace más manejable pero también menos potente.

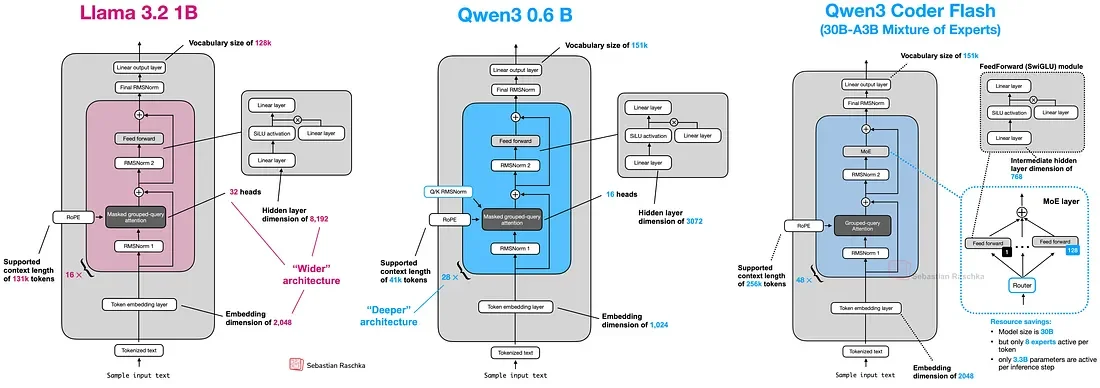

- Diferenciadores técnicos clave: Uso de Mixture-of-Experts (MoE) para activar solo una parte de los parámetros para consultas, mejorando la eficiencia sin sacrificar el rendimiento. Implementación de técnicas avanzadas como Grouped-Query Attention (GQA) y RoPE (Rotary Position Embedding).

Casos de uso #

- Stack de IA Privado: Integración en pipelines propietarias

- Soluciones para Clientes: Implementación para proyectos de clientes

- Aceleración del Desarrollo: Reducción del tiempo de comercialización de proyectos

- Inteligencia Estratégica: Entrada para la hoja de ruta tecnológica

- Análisis Competitivo: Monitoreo del ecosistema de IA

Recursos #

Enlaces Originales #

- A Step-by-Step Implementation of Qwen 3 MoE Architecture from Scratch - Enlace original

Artículo recomendado y seleccionado por el equipo Human Technology eXcellence elaborado mediante inteligencia artificial (en este caso con LLM HTX-EU-Mistral3.1Small) el 2025-09-23 16:51 Fuente original: https://github.com/FareedKhan-dev/qwen3-MoE-from-scratch

Artículos Relacionados #

- Cómo segmentar videos con Segment Anything 3 (SAM3) - JavaScript, Java

- Construye un Modelo de Lenguaje Grande (Desde Cero) - Foundation Model, LLM, Open Source

- Kimi K2: Inteligencia Agente Abierta - AI Agent, Foundation Model