Tipo: Artículo web Enlace original: https://www.krupadave.com/articles/everything-about-transformers?x=v3 Fecha de publicación: 2024-01-15

Resumen #

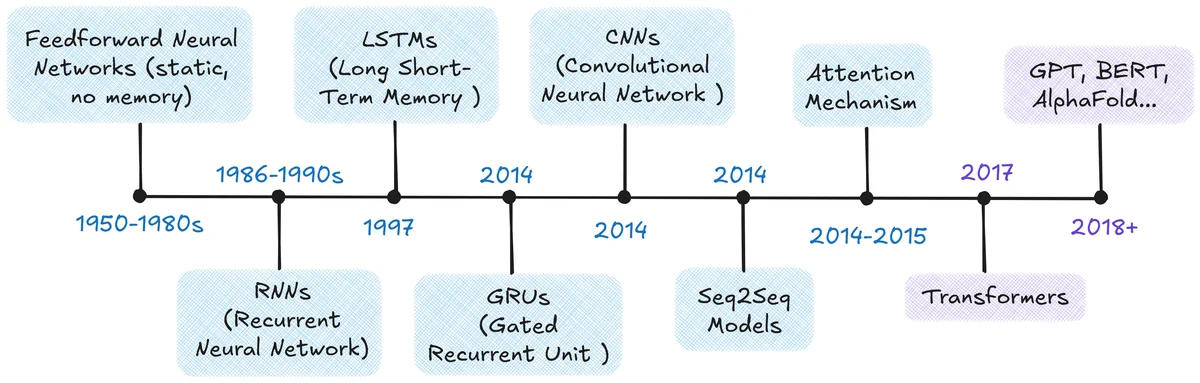

QUÉ - Este artículo trata sobre la historia y el funcionamiento de la arquitectura de los transformadores, un modelo de deep learning fundamental para el procesamiento del lenguaje natural (NLP). Proporciona una explicación visual e intuitiva de la evolución de los modelos de lenguaje, desde el uso de redes neuronales recurrentes (RNN) hasta los modernos transformadores.

POR QUÉ - Es relevante para el negocio de la IA porque los transformadores son la base de muchos modelos avanzados de NLP, como BERT y GPT. Comprender su funcionamiento y evolución es crucial para desarrollar nuevas soluciones competitivas de IA.

QUIÉN - El autor es Krupa Dave, un experto en el campo de la IA. El artículo está publicado en el sitio personal de Dave, que se dirige a un público técnico interesado en la IA y el machine learning.

DÓNDE - Se posiciona en el mercado de la educación técnica y la divulgación científica en el campo de la IA. Es útil para profesionales y investigadores que desean profundizar en la comprensión de los transformadores.

CUÁNDO - El artículo fue publicado el 15 de enero de 2024, reflejando los conocimientos actuales y las tendencias recientes en el campo de la IA.

IMPACTO EN EL NEGOCIO:

- Oportunidades: Proporciona una base sólida para el desarrollo de nuevos modelos de NLP, mejorando la competencia interna sobre la arquitectura de los transformadores.

- Riesgos: No representa un riesgo directo, pero ignorar las innovaciones descritas podría llevar a un retraso competitivo.

- Integración: Puede ser utilizado para formar al equipo técnico, mejorando la capacidad de innovación y desarrollo de nuevos productos de IA.

RESUMEN TÉCNICO:

- Pila tecnológica principal: El artículo discute la arquitectura de los transformadores, incluidos codificadores, decodificadores, mecanismos de atención (self-attention, cross-attention, masked self-attention, multi-head attention), redes feed-forward, normalización de capas, codificación posicional y conexiones residuales.

- Escalabilidad y límites arquitectónicos: Los transformadores son conocidos por su capacidad de escalar de manera efectiva, permitiendo el procesamiento de secuencias de datos en paralelo. Sin embargo, requieren recursos computacionales significativos.

- Diferenciadores técnicos clave: El uso de la atención como mecanismo principal para el procesamiento de secuencias de datos, permitiendo una mayor flexibilidad y precisión en comparación con los modelos anteriores.

Casos de uso #

- Private AI Stack: Integración en pipelines propietarias

- Client Solutions: Implementación para proyectos de clientes

- Strategic Intelligence: Input para la hoja de ruta tecnológica

- Competitive Analysis: Monitoreo del ecosistema de IA

Recursos #

Enlaces Originales #

- Everything About Transformers - Enlace original

Artículo recomendado y seleccionado por el equipo Human Technology eXcellence elaborado mediante inteligencia artificial (en este caso con LLM HTX-EU-Mistral3.1Small) el 2025-10-31 07:33 Fuente original: https://www.krupadave.com/articles/everything-about-transformers?x=v3

Artículos Relacionados #

- El obituario RAG: Asesinado por agentes, enterrado por ventanas de contexto - AI Agent, Natural Language Processing

- Los grandes modelos de lenguaje son competentes en resolver y crear pruebas de inteligencia emocional | Psicología de la Comunicación - AI, LLM, Foundation Model

- Cómo obtener clasificación consistente de modelos de lenguaje grandes inconsistentes? - Foundation Model, Go, LLM