Typ: Content

Originaler Link: https://x.com/zhengyaojiang/status/1990218960617492784?s=43&t=ANuJI-IuN5rdsaLueycEbA

Veröffentlichungsdatum: 2025-11-18

Zusammenfassung #

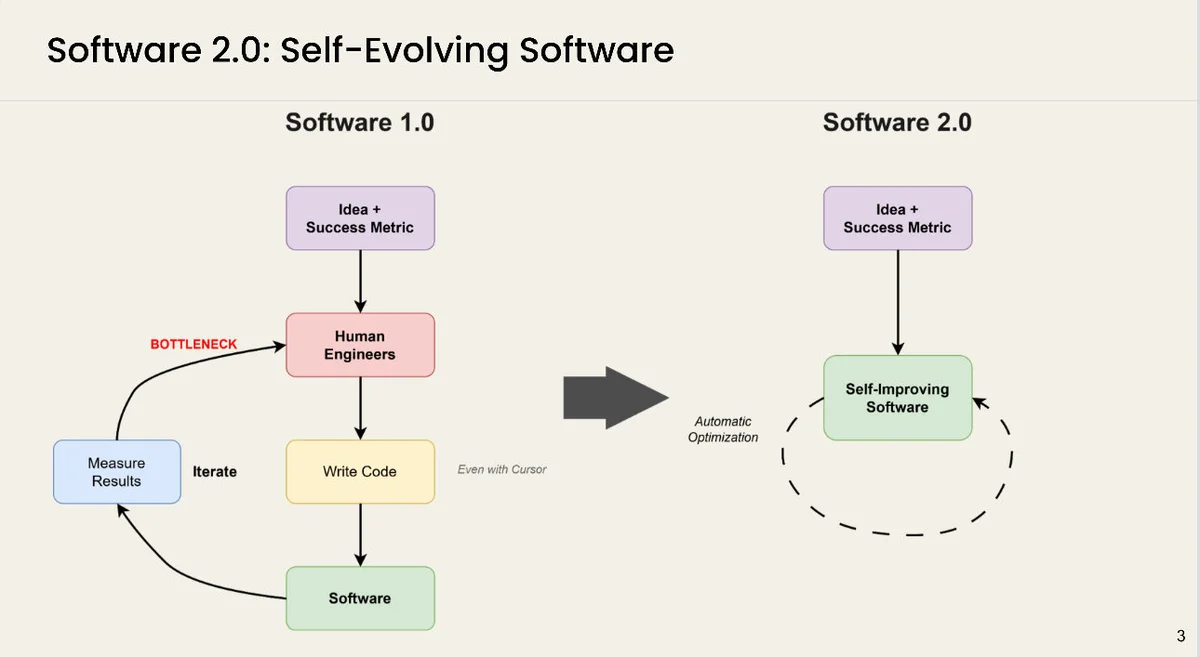

WAS - Weco ist eine Plattform, die es Benutzern ermöglicht, Bewertungsskripte (Verifizierer) zu schreiben, um den Code zu optimieren. Weco iteriert den Code, um ihn basierend auf diesen Skripten zu optimieren.

WARUM - Es ist für das AI-Geschäft relevant, weil es den Prozess der Code-Optimierung automatisiert, wodurch Zeit und menschliche Fehler reduziert werden. Dies ist entscheidend für die Entwicklung effizienter und leistungsfähiger AI-Modelle.

WER - Die Hauptakteure sind Weco und seine Benutzer, die Entwickler und Unternehmen sein können, die ihre AI-Algorithmen optimieren müssen.

WO - Weco positioniert sich im Markt der Plattformen für die Entwicklung und Optimierung von AI-Software, wobei es mit Tools zur Automatisierung und Code-Optimierung konkurriert.

WANN - Weco repräsentiert einen aufstrebenden Trend im AI-Markt, der den Fokus von der Prozessschreibung zur Bewertungsschreibung verlagert, was eine zunehmende Reife in der Automatisierung von Optimierungsoperationen anzeigt.

GESCHÄFTLICHE AUSWIRKUNGEN:

- Chancen: Weco bietet einen Wettbewerbsvorteil, indem es eine schnelle und genaue Optimierung des AI-Codes ermöglicht. Dies kann die Entwicklung neuer Modelle beschleunigen und die Leistung bestehender Modelle verbessern.

- Risiken: Die Abhängigkeit von einer externen Plattform für die Code-Optimierung könnte ein Risiko darstellen, wenn die Plattform Sicherheits- oder Zuverlässigkeitsprobleme hat.

- Integration: Weco kann in den bestehenden Unternehmensstack integriert werden, um den Prozess der Code-Optimierung zu automatisieren, wodurch die manuelle Arbeitsbelastung reduziert und die operative Effizienz verbessert wird.

TECHNISCHE ZUSAMMENFASSUNG:

- Core-Technologiestack: Weco verwendet benutzerdefinierte Bewertungsskripte (Verifizierer), um den Code zu optimieren. Die Plattform iteriert automatisch den Code, um die Leistung basierend auf den von den Benutzern bereitgestellten Skripten zu verbessern.

- Skalierbarkeit: Die Skalierbarkeit hängt von der Fähigkeit der Plattform ab, eine große Anzahl von Bewertungsskripten zu verwalten und schnell auf den Code zu iterieren. Die Skalierbarkeit kann durch die Komplexität der Skripte und die Größe des zu optimierenden Codes eingeschränkt werden.

- Wichtige technische Differenzierer: Der Ansatz von Weco, die Prozessschreibung von der Bewertungsschreibung zu trennen, ist ein wichtiger Differenzierer. Dies ermöglicht eine größere Flexibilität und Genauigkeit bei der Code-Optimierung und reduziert die Zeit, die für optimale Ergebnisse benötigt wird.

Anwendungsfälle #

- Private AI Stack: Integration in proprietäre Pipelines

- Client Solutions: Implementierung für Kundenprojekte

- Strategische Intelligenz: Input für technologische Roadmap

- Wettbewerbsanalyse: Überwachung des AI-Ökosystems

Ressourcen #

Original Links #

Artikel empfohlen und ausgewählt vom Human Technology eXcellence Team, erstellt mit KI (in diesem Fall mit LLM HTX-EU-Mistral3.1Small) am 2025-11-18 14:09 Quelle: https://x.com/zhengyaojiang/status/1990218960617492784?s=43&t=ANuJI-IuN5rdsaLueycEbA

Verwandte Artikel #

- GitHub Projects Community (@GithubProjects) auf X - Machine Learning

- Dieser Claude Code-Aufruf verwandelt Claude Code buchstäblich in Ultradenken… - Computer Vision

- 🚀 Hallo, Kimi K2 Denken! Das Open-Source-Denkagentenmodell ist da! - Natural Language Processing, AI Agent, Foundation Model