Typ: GitHub Repository Original-Link: https://github.com/FareedKhan-dev/qwen3-MoE-from-scratch Veröffentlichungsdatum: 2025-09-20

Zusammenfassung #

WAS - Dies ist ein Tutorial, das die Erstellung eines Qwen 3 MoE (Mixture-of-Experts) Modells von Grund auf mit Jupyter Notebook anleitet. Das Tutorial basiert auf einem Medium-Artikel und enthält ein GitHub-Repository mit Code und zusätzlichen Ressourcen.

WARUM - Es ist für das AI-Geschäft relevant, da es eine praktische Anleitung zur Implementierung eines fortschrittlichen LLM (Large Language Model) Modells bietet, das zur Verbesserung der Sprachverarbeitungsfähigkeiten genutzt werden kann. Dies kann zu effizienteren und spezialisierteren Lösungen für AI-Anwendungen führen.

WER - Die Hauptakteure sind Fareed Khan, Autor des Tutorials, und Alibaba, das das Qwen 3 Modell entwickelt hat. Die Zielgruppe sind Entwickler und AI-Forscher.

WO - Es positioniert sich im Bildungsmarkt für AI, indem es Ressourcen für die Entwicklung fortschrittlicher LLM-Modelle bietet. Es ist Teil des Open-Source-Tools-Ökosystems für AI.

WANN - Das Tutorial wurde 2025 veröffentlicht, was darauf hinweist, dass es auf aktuellen und fortschrittlichen Technologien basiert. Die Reife des Inhalts hängt von der Verbreitung und dem Einsatz des Qwen 3 Modells ab.

GESCHÄFTLICHE AUSWIRKUNGEN:

- Chancen: Die Implementierung von MoE-Modellen kann die Effizienz und Spezialisierung von AI-Lösungen verbessern und einen Wettbewerbsvorteil bieten.

- Risiken: Die Abhängigkeit von Open-Source-Technologien kann Risiken in Bezug auf Wartung und Code-Updates mit sich bringen.

- Integration: Das Tutorial kann zur Schulung des internen Entwicklungsteams genutzt werden, um die erworbenen Kenntnisse in den bestehenden Technologiestack zu integrieren.

TECHNISCHE ZUSAMMENFASSUNG:

- Kern-Technologie-Stack: Jupyter Notebook, Python, PyTorch, Hugging Face Hub, sentencepiece, tiktoken, torch, matplotlib, tokenizers, safetensors.

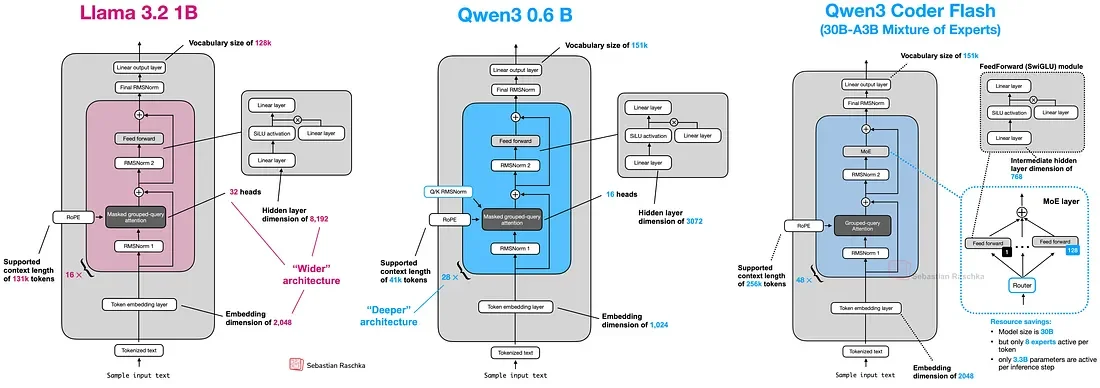

- Skalierbarkeit und architektonische Grenzen: Das beschriebene Modell hat 0,8 Milliarden Parameter, deutlich weniger als die 235 Milliarden des ursprünglichen Qwen 3 Modells. Dies macht es handhabbarer, aber auch weniger leistungsfähig.

- Wichtige technische Differenzierer: Nutzung von Mixture-of-Experts (MoE), um nur einen Teil der Parameter für Abfragen zu aktivieren, wodurch die Effizienz verbessert wird, ohne die Leistung zu beeinträchtigen. Implementierung fortschrittlicher Techniken wie Grouped-Query Attention (GQA) und RoPE (Rotary Position Embedding).

Anwendungsfälle #

- Private AI Stack: Integration in proprietäre Pipelines

- Client Solutions: Implementierung für Kundenprojekte

- Development Acceleration: Reduzierung der Time-to-Market für Projekte

- Strategische Intelligenz: Input für die technologische Roadmap

- Wettbewerbsanalyse: Überwachung des AI-Ökosystems

Ressourcen #

Original-Links #

Artikel empfohlen und ausgewählt vom Human Technology eXcellence Team, erstellt mit KI (in diesem Fall mit LLM HTX-EU-Mistral3.1Small) am 2025-09-23 16:51 Quelle: https://github.com/FareedKhan-dev/qwen3-MoE-from-scratch

Verwandte Artikel #

- Anthropics interaktiver Tutorial zur Prompt-Engineering - Open Source

- Ein Großes Sprachmodell (Von Grund Auf) Bauen - Foundation Model, LLM, Open Source

- Wie man Videos mit Segment Anything 3 (SAM3) segmentiert - JavaScript, Java