Type: Web Article Original link: https://www.nature.com/articles/s41586-025-09215-4 Publication date: 2024-10-26

Résumé #

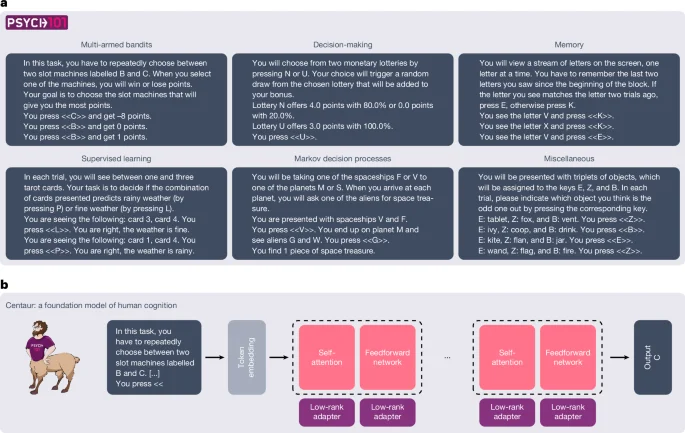

QUOI - L’article de Nature présente Centaur, un modèle informatique qui prédit et simule le comportement humain dans des expériences exprimables en langage naturel. Centaur a été développé en affinant un modèle linguistique avancé sur un grand ensemble de données appelé Psych-101.

POURQUOI - Il est pertinent pour le secteur de l’IA car il démontre la possibilité de créer des modèles qui capturent le comportement humain dans divers contextes, guidant le développement de théories cognitives et améliorant potentiellement les interactions homme-machine.

QUI - Les auteurs de l’article, publié dans Nature, sont les principaux acteurs. Aucun détail n’est fourni sur l’entreprise ou la communauté derrière Centaur.

OÙ - Il se positionne sur le marché de la recherche cognitive et de l’IA, offrant une approche unifiée pour comprendre le comportement humain.

QUAND - L’article a été publié le 26 octobre 2024, indiquant une avancée récente dans le domaine de la modélisation cognitive.

IMPACT COMMERCIAL:

- Opportunités: Développer des modèles d’IA plus intuitifs et adaptables, améliorant les applications d’interaction homme-machine.

- Risques: Concurrence de la part d’autres entreprises adoptant des modèles similaires pour améliorer leurs solutions d’IA.

- Intégration: Intégration possible avec les systèmes d’intelligence artificielle existants pour améliorer la compréhension du comportement humain.

RÉSUMÉ TECHNIQUE:

- Technologie principale: Langage naturel, modèles linguistiques avancés, grands ensembles de données (Psych-101).

- Scalabilité: Le modèle démontre des capacités de généralisation à de nouveaux domaines et situations non vues.

- Différenciateurs techniques: Alignement des représentations internes du modèle avec l’activité neurale humaine, améliorant la précision des prédictions comportementales.

Cas d’utilisation #

- Private AI Stack: Intégration dans des pipelines propriétaires

- Solutions Client: Mise en œuvre pour des projets clients

- Intelligence Stratégique: Entrées pour la feuille de route technologique

- Analyse Concurrentielle: Surveillance de l’écosystème AI

Ressources #

Liens Originaux #

Article recommandé et sélectionné par l’équipe Human Technology eXcellence élaboré via l’intelligence artificielle (dans ce cas avec LLM HTX-EU-Mistral3.1Small) le 2025-09-06 10:28 Source originale: https://www.nature.com/articles/s41586-025-09215-4

Articles Associés #

- Voxtral | Mistral AI - IA, Modèle de Fondement

- How Dataherald Makes Natural Language to SQL Easy - Traitement du Langage Naturel, IA

- MCP is eating the world—and it’s here to stay - Traitement du Langage Naturel, IA, Modèle de Fondement

Le Point de Vue HTX #

Ce sujet est au cœur de ce que nous construisons chez HTX. La technologie présentée ici — qu’il s’agisse d’agents IA, de modèles de langage ou de traitement de documents — représente exactement le type de capacités dont les entreprises européennes ont besoin, mais déployées selon leurs propres conditions.

Le défi n’est pas de savoir si cette technologie fonctionne. Elle fonctionne. Le défi est de la déployer sans envoyer les données de votre entreprise vers des serveurs américains, sans violer le RGPD et sans créer des dépendances fournisseur dont vous ne pouvez pas sortir.

C’est pourquoi nous avons créé ORCA — un chatbot d’entreprise privé qui apporte ces capacités à votre infrastructure. Même puissance que ChatGPT, mais vos données ne quittent jamais votre périmètre.

Vous voulez savoir si votre entreprise est prête pour l’IA ? Faites notre évaluation gratuite — 5 minutes, rapport personnalisé, feuille de route actionnable.

Articles Connexes #

- Comment Dataherald Rendre Facile la Conversion du Langage Naturel en SQL - Natural Language Processing, AI

- Conception de flux de travail GenAI optimaux de Pareto avec syftr - AI Agent, AI

- Les grands modèles de langage sont compétents pour résoudre et créer des tests d’intelligence émotionnelle | Psychologie de la communication - AI, LLM, Foundation Model

FAQ

Les grands modèles de langage peuvent-ils fonctionner sur une infrastructure privée ?

Oui. Les modèles open source comme LLaMA, Mistral, DeepSeek et Qwen peuvent fonctionner on-premise ou sur un cloud européen. Ces modèles atteignent des performances comparables à GPT-4 pour la plupart des tâches métier, avec l'avantage d'une souveraineté complète sur les données.

Quel LLM est le meilleur pour un usage professionnel ?

Le meilleur modèle dépend de votre cas d'usage. Pour l'analyse de documents et le chat, Mistral et LLaMA excellent. Pour l'analyse de données, DeepSeek offre un raisonnement solide. L'approche de HTX est agnostique : ORCA supporte plusieurs modèles.