Type: Web Article Original link: https://www.deeplearning.ai/the-batch/issue-307/ Publication date: 2025-09-06

Résumé #

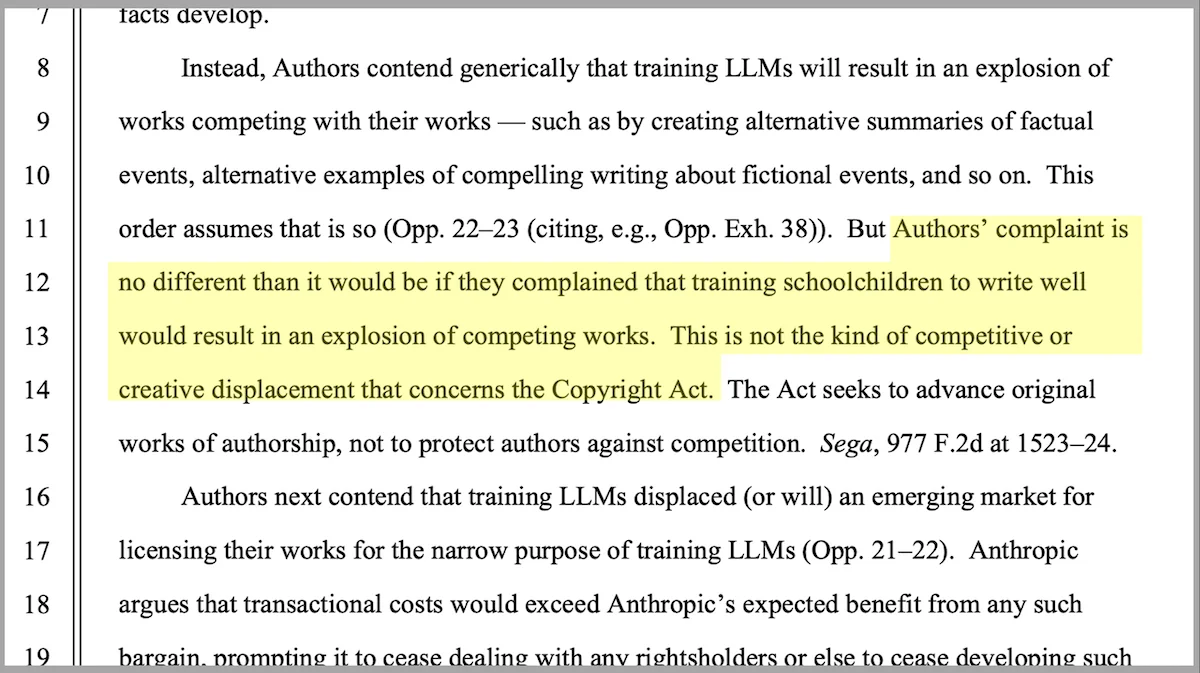

QUOI - Cet article discute d’une décision judiciaire qui a établi que l’entraînement de modèles linguistiques sur des livres protégés par le droit d’auteur est considéré comme un usage équitable. Il présente également un cours éducatif sur le protocole de communication des agents (ACP) et une nouvelle sur un accord entre Meta et Scale AI.

POURQUOI - La décision est pertinente pour le secteur de l’IA car elle clarifie les réglementations sur l’utilisation de données protégées par le droit d’auteur pour l’entraînement des modèles, réduisant ainsi l’ambiguïté juridique et facilitant l’accès aux données. Le cours sur l’ACP est pertinent pour le développement d’agents IA interopérables, tandis que l’accord entre Meta et Scale AI indique une tendance vers l’acquisition de talents et de technologies pour le traitement des données.

QUI - Les principaux acteurs incluent:

- Cour de district des États-Unis: a rendu la décision sur l’usage équitable.

- Anthropic: entreprise impliquée dans le litige juridique.

- Meta: a conclu un accord avec Scale AI.

- Scale AI: fournisseur de services d’étiquetage de données.

- DeepLearning.AI: plateforme éducative offrant des cours sur l’ACP.

OÙ - La décision s’inscrit dans le contexte juridique de l’IA, tandis que le cours sur l’ACP et l’accord entre Meta et Scale AI se situent dans le marché des technologies de l’IA et du traitement des données.

QUAND - La décision est récente et pourrait influencer les futures pratiques juridiques. Le cours sur l’ACP est actuel et reflète les tendances éducatives dans le secteur de l’IA. L’accord entre Meta et Scale AI est un événement récent indiquant une tendance vers l’acquisition de talents et de technologies.

IMPACT COMMERCIAL:

- Opportunités: Clarification juridique sur l’utilisation de données protégées par le droit d’auteur pour l’entraînement des modèles d’IA. Possibilité d’intégrer l’ACP pour améliorer l’interopérabilité des agents d’IA. Accès à des talents et technologies avancés grâce à des accords stratégiques.

- Risques: Appels potentiels à la décision qui pourraient réintroduire l’ambiguïté juridique. Concurrence intense pour l’acquisition de talents et de technologies dans le secteur de l’IA.

- Intégration: L’ACP peut être intégré dans la pile existante pour améliorer la collaboration entre les agents d’IA. L’accès à des données de haute qualité, comme discuté, est crucial pour l’amélioration continue des modèles d’IA.

RÉSUMÉ TECHNIQUE:

- Technologies principales: La décision et l’article ne spécifient pas de technologies particulières, mais mentionnent des concepts tels que API, bases de données, cloud, apprentissage automatique, IA, réseaux neuronaux, frameworks et bibliothèques.

- Scalabilité et limites architecturales: La décision n’affecte pas directement la scalabilité, mais l’accès à des données de haute qualité est crucial pour la scalabilité des modèles d’IA. L’ACP peut améliorer l’interopérabilité entre les agents d’IA, mais nécessite une standardisation.

- Différenciateurs techniques clés: La décision clarifie les réglementations juridiques, réduisant les risques juridiques pour les entreprises d’IA. L’ACP offre un protocole standardisé pour la communication entre les agents d’IA, améliorant ainsi l’interopérabilité. L’accord entre Meta et Scale AI indique un investissement significatif dans les talents et les technologies pour le traitement des données.

Cas d’utilisation #

- Pile d’IA privée: Intégration dans des pipelines propriétaires

- Solutions client: Mise en œuvre pour des projets clients

- Intelligence stratégique: Entrée pour la feuille de route technologique

- Analyse concurrentielle: Surveillance de l’écosystème AI

Ressources #

Liens originaux #

- Judge Rules Training AI on Copyrighted Works Is Fair Use, Agentic Biology Evolves, and more… - Lien original

Article recommandé et sélectionné par l’équipe Human Technology eXcellence élaboré via intelligence artificielle (dans ce cas avec LLM HTX-EU-Mistral3.1Small) le 2025-09-06 10:29 Source originale: https://www.deeplearning.ai/the-batch/issue-307/

Articles connexes #

- DeepLearning.AI: Start or Advance Your Career in AI - IA

- Alexander Kruel - Links for 2025-08-24 - Modèle de base, IA

- CS294/194-196 Large Language Model Agents | CS 194/294-196 Large Language Model Agents - Agent IA, Modèle de base, LLM

Le Point de Vue HTX #

Ce sujet est au cœur de ce que nous construisons chez HTX. La technologie présentée ici — qu’il s’agisse d’agents IA, de modèles de langage ou de traitement de documents — représente exactement le type de capacités dont les entreprises européennes ont besoin, mais déployées selon leurs propres conditions.

Le défi n’est pas de savoir si cette technologie fonctionne. Elle fonctionne. Le défi est de la déployer sans envoyer les données de votre entreprise vers des serveurs américains, sans violer le RGPD et sans créer des dépendances fournisseur dont vous ne pouvez pas sortir.

C’est pourquoi nous avons créé ORCA — un chatbot d’entreprise privé qui apporte ces capacités à votre infrastructure. Même puissance que ChatGPT, mais vos données ne quittent jamais votre périmètre.

Vous voulez savoir si votre entreprise est prête pour l’IA ? Faites notre évaluation gratuite — 5 minutes, rapport personnalisé, feuille de route actionnable.

Articles Connexes #

- Théorie des jeux | Open Yale Courses - Tech

- Agents de Modèles de Langage de Grande Taille CS294/194-196 | Agents de Modèles de Langage de Grande Taille CS 194/294-196 - AI Agent, Foundation Model, LLM

- Loi sur l’IA, il existe un code de conduite pour une approche responsable et facilitée pour les PME - Cyber Sécurité 360 - Best Practices, AI, Go

FAQ

Comment les agents IA peuvent-ils bénéficier à mon entreprise ?

Les agents IA peuvent automatiser des tâches complexes multi-étapes comme l'analyse de données, le traitement de documents et les interactions clients. Pour les PME européennes, déployer des agents sur une infrastructure privée avec des outils comme ORCA garantit que les données sensibles ne quittent jamais votre périmètre tout en exploitant des capacités IA de pointe.

Les agents IA sont-ils sûrs pour les données d'entreprise ?

Cela dépend du déploiement. Les agents cloud envoient vos données à des serveurs externes, créant des risques RGPD. Les agents IA privés fonctionnant sur votre propre infrastructure — comme ceux construits sur le stack PRISMA de HTX — gardent toutes les données sous votre contrôle.