Typ: Web-Artikel Original-Link: https://www.krupadave.com/articles/everything-about-transformers?x=v3 Veröffentlichungsdatum: 2024-01-15

Zusammenfassung #

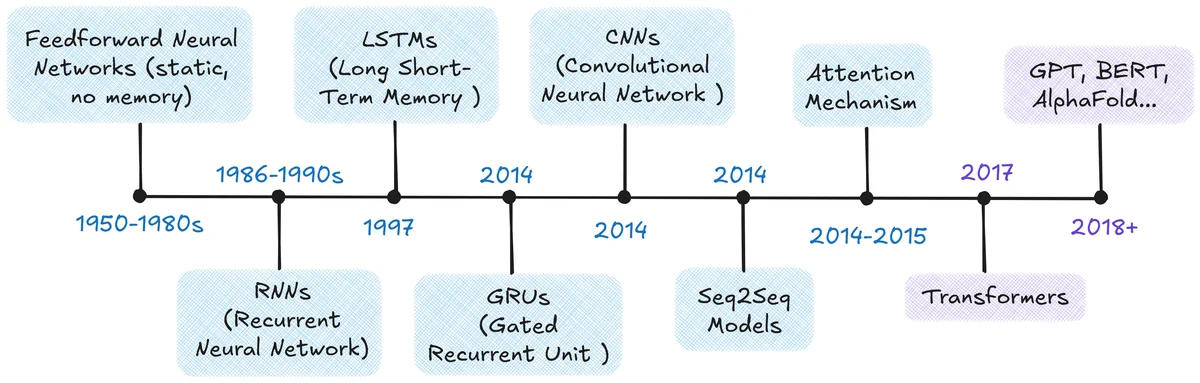

WAS - Dieser Artikel behandelt die Geschichte und Funktionsweise der Transformer-Architektur, einem grundlegenden Deep-Learning-Modell für die Verarbeitung natürlicher Sprache (NLP). Er bietet eine visuelle und intuitive Erklärung der Entwicklung von Sprachmodellen, von der Verwendung rekurrenter neuronaler Netze (RNN) bis hin zu modernen Transformern.

WARUM - Er ist für das AI-Geschäft relevant, da Transformer die Grundlage vieler fortschrittlicher NLP-Modelle wie BERT und GPT bilden. Das Verständnis ihrer Funktionsweise und Entwicklung ist entscheidend für die Entwicklung neuer wettbewerbsfähiger AI-Lösungen.

WER - Der Autor ist Krupa Dave, eine Expertin im Bereich AI. Der Artikel wird auf der persönlichen Website von Dave veröffentlicht, die sich an ein technisches Publikum richtet, das sich für AI und maschinelles Lernen interessiert.

WO - Er positioniert sich im Markt für technische Bildung und wissenschaftliche Verbreitung im Bereich AI. Er ist nützlich für Fachleute und Forscher, die ihr Verständnis der Transformer vertiefen möchten.

WANN - Der Artikel wurde am 15. Januar 2024 veröffentlicht und spiegelt die aktuellen Kenntnisse und Trends im Bereich AI wider.

GESCHÄFTLICHE AUSWIRKUNGEN:

- Chancen: Bietet eine solide Grundlage für die Entwicklung neuer NLP-Modelle und verbessert das interne Know-how über die Transformer-Architektur.

- Risiken: Stellt kein direktes Risiko dar, aber das Ignorieren der beschriebenen Innovationen könnte zu einem Wettbewerbsnachteil führen.

- Integration: Kann zur Schulung des technischen Teams verwendet werden und verbessert die Innovations- und Entwicklungsfähigkeiten neuer AI-Produkte.

TECHNISCHE ZUSAMMENFASSUNG:

- Kern-Technologie-Stack: Der Artikel diskutiert die Transformer-Architektur, einschließlich Encoder, Decoder, Aufmerksamkeitsmechanismen (Self-Attention, Cross-Attention, Masked Self-Attention, Multi-Head Attention), Feed-Forward-Netzwerke, Layer-Normalisierung, Positional Encoding und Residual Connections.

- Skalierbarkeit und architektonische Grenzen: Transformer sind für ihre Fähigkeit bekannt, effektiv zu skalieren und das parallele Verarbeiten von Datensequenzen zu ermöglichen. Sie erfordern jedoch erhebliche Rechenressourcen.

- Wichtige technische Differenzierer: Die Verwendung von Aufmerksamkeit als Hauptmechanismus zur Verarbeitung von Datensequenzen, was im Vergleich zu früheren Modellen eine größere Flexibilität und Genauigkeit ermöglicht.

Anwendungsfälle #

- Private AI Stack: Integration in proprietäre Pipelines

- Client Solutions: Implementierung für Kundenprojekte

- Strategische Intelligenz: Input für technologische Roadmaps

- Wettbewerbsanalyse: Überwachung des AI-Ökosystems

Ressourcen #

Original-Links #

- Everything About Transformers - Original-Link

Artikel empfohlen und ausgewählt vom Human Technology eXcellence Team, erstellt mit KI (in diesem Fall mit LLM HTX-EU-Mistral3.1Small) am 2025-10-31 07:33 Quelle: https://www.krupadave.com/articles/everything-about-transformers?x=v3

Verwandte Artikel #

- Ein Grundmodell zur Vorhersage und Erfassung der menschlichen Kognition | Nature - Go, Foundation Model, Natural Language Processing

- Wieder das Exponentielle nicht verstehen - AI

- Große Sprachmodelle sind in der Lage, emotionale Intelligenztests zu lösen und zu erstellen | Kommunikationspsychologie - AI, LLM, Foundation Model