Tipo: Hacker News Discussion

Link originale: https://news.ycombinator.com/item?id=45571423

Data pubblicazione: 2025-10-13

Autore: frenchmajesty

Sintesi #

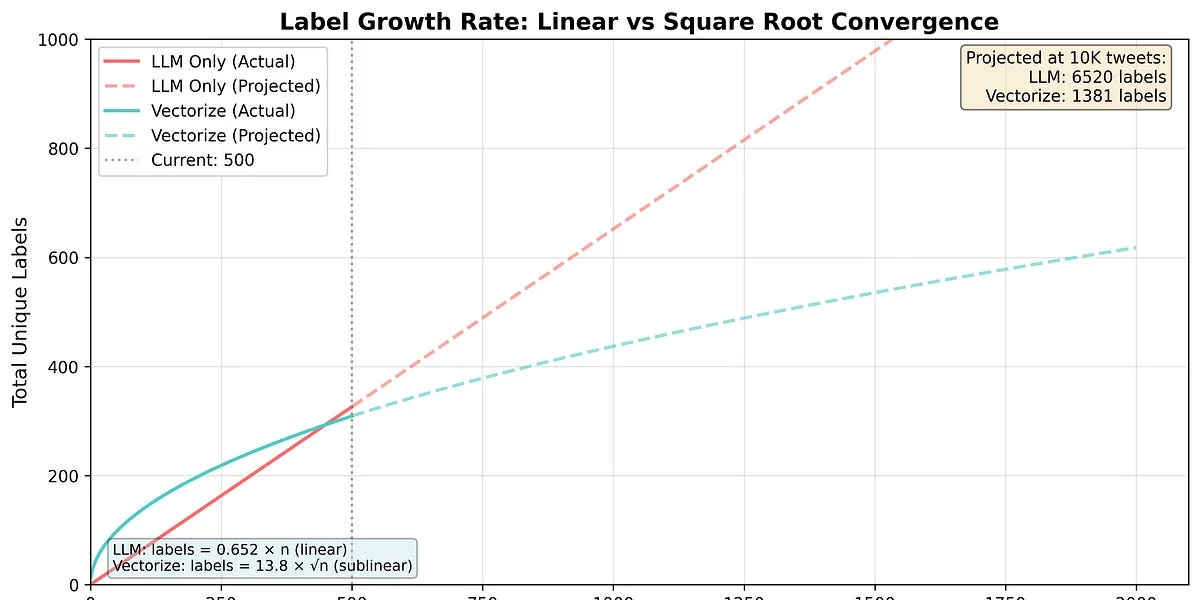

WHAT - Tecniche per ottenere classificazioni coerenti da modelli linguistici grandi (LLM) stocastici, con implementazione in Golang. Risolve il problema dell’inconsistenza nelle etichette generate dai modelli.

WHY - Rilevante per migliorare l’affidabilità delle classificazioni automatizzate, riducendo errori e costi associati all’etichettatura manuale. Risolve il problema dell’inconsistenza nelle etichette generate dai modelli.

WHO - Autore: Verdi Oct. Community di sviluppatori e ingegneri ML, utenti di API di modelli linguistici.

WHERE - Posizionato nel mercato delle soluzioni AI per l’etichettatura automatizzata, rivolto a team di sviluppo e aziende che utilizzano LLMs.

WHEN - Nuovo approccio, trend emergente. La discussione su Hacker News indica interesse attuale e potenziale adozione.

BUSINESS IMPACT:

- Opportunità: Miglioramento della qualità delle etichette dati, riduzione dei costi operativi, aumento dell’efficienza nei processi di etichettatura.

- Rischi: Dipendenza da API esterne, potenziale obsolescenza tecnologica.

- Integrazione: Possibile integrazione con stack esistente per l’etichettatura automatizzata, miglioramento dei flussi di lavoro di data labeling.

TECHNICAL SUMMARY:

- Core technology stack: Golang, API di modelli linguistici (es. OpenAI), logit_bias, json_schema.

- Scalabilità: Buona scalabilità grazie all’uso di API esterne, limiti legati alla gestione di grandi volumi di dati.

- Differenziatori tecnici: Uso di logit_bias e json_schema per migliorare la coerenza delle etichette, implementazione in Golang per performance elevate.

DISCUSSIONE HACKER NEWS: La discussione su Hacker News ha evidenziato principalmente le problematiche legate alle performance e alla risoluzione dei problemi tecnici. Gli utenti hanno discusso le sfide legate all’implementazione di soluzioni di etichettatura automatizzata e le potenziali soluzioni tecniche. Il sentimento generale è di interesse e curiosità, con una certa cautela riguardo alla dipendenza da API esterne. I temi principali emersi sono stati la performance, il problema tecnico, e la gestione dei database. La community ha mostrato un interesse pratico e tecnico, con un focus sulla risoluzione dei problemi concreti legati all’uso di LLMs.

Casi d’uso #

- Private AI Stack: Integrazione in pipeline proprietarie

- Client Solutions: Implementazione per progetti clienti

Feedback da terzi #

Community feedback: La community HackerNews ha commentato con focus su performance, problem (20 commenti).

Risorse #

Link Originali #

- My trick for getting consistent classification from LLMs - Link originale

Articolo segnalato e selezionato dal team Human Technology eXcellence elaborato tramite intelligenza artificiale (in questo caso con LLM HTX-EU-Mistral3.1Small) il 2025-10-23 13:56 Fonte originale: https://news.ycombinator.com/item?id=45571423

Articoli Correlati #

- Apertus 70B: Truly Open - Swiss LLM by ETH, EPFL and CSCS - LLM, AI, Foundation Model

- Show HN: My LLM CLI tool can run tools now, from Python code or plugins - LLM, Foundation Model, Python

- Llama-Scan: Convert PDFs to Text W Local LLMs - LLM, Natural Language Processing