Type: Content

Original link: https://x.com/varchasvee_/status/1986811191474401773?s=43&t=ANuJI-IuN5rdsaLueycEbA

Publication date: 2025-11-12

Résumé #

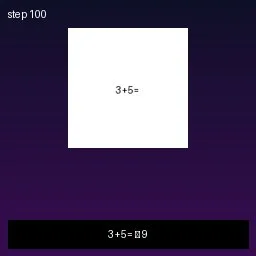

QUOI - Un post sur Twitter discutant de la suppression des tokeniseurs dans les modèles de reconnaissance optique de caractères (OCR), basé sur un post d’Andrej Karpathy.

POURQUOI - Pertinent pour le secteur de l’IA car il suggère une approche innovante pour améliorer l’efficacité et la précision des modèles OCR, en éliminant la nécessité de tokenisation.

QUI - Andrej Karpathy (auteur du post original), Varun Sharma (auteur du tweet), communauté des développeurs et chercheurs en IA.

OÙ - Situé dans le contexte du débat technique sur l’OCR et le TALN, au sein de la communauté AI sur Twitter.

QUAND - Le tweet a été publié le 2024-05-16, reflétant une tendance actuelle d’innovation dans les modèles OCR.

IMPACT COMMERCIAL:

- Opportunités: Développer des modèles OCR sans tokeniseurs peut réduire la complexité et améliorer la précision, offrant un avantage concurrentiel.

- Risques: La transition pourrait nécessiter des investissements significatifs en recherche et développement.

- Intégration: Intégration possible avec les outils OCR existants pour tester et valider l’approche sans tokeniseurs.

RÉSUMÉ TECHNIQUE:

- Technologie principale: Modèles OCR qui lisent le texte directement à partir des pixels, en contournant la tokenisation.

- Scalabilité et limites: La scalabilité dépend de la capacité du modèle à gérer différentes résolutions et types de texte. Les limites incluent la nécessité de grands ensembles de données pour l’entraînement.

- Différenciateurs techniques: Suppression de la tokenisation, réduction de la complexité du modèle, amélioration potentielle de la précision.

Cas d’utilisation #

- Private AI Stack: Intégration dans des pipelines propriétaires

- Solutions client: Mise en œuvre pour des projets clients

- Intelligence stratégique: Entrée pour la feuille de route technologique

- Analyse concurrentielle: Surveillance de l’écosystème AI

Ressources #

Liens originaux #

- said we should delete tokenizers - Lien original

Article signalé et sélectionné par l’équipe Human Technology eXcellence élaboré via l’intelligence artificielle (dans ce cas avec LLM HTX-EU-Mistral3.1Small) le 2025-11-12 17:59 Source originale: https://x.com/varchasvee_/status/1986811191474401773?s=43&t=ANuJI-IuN5rdsaLueycEbA

Articles connexes #

- 🚀 Hello, Kimi K2 Thinking! The Open-Source Thinking Agent Model is here - Natural Language Processing, AI Agent, Foundation Model

- I quite like the new DeepSeek-OCR paper - Foundation Model, Go, Computer Vision

- We used DeepSeek OCR to extract every dataset from tables/charts ac… - AI

Articles Connexes #

- Ce prompt Claude Code transforme littéralement Claude Code en ultrathink… - Computer Vision

- 🚀 Bonjour, Kimi K2 Thinking ! Le Modèle d’Agent de Pensée Open-Source est là. - Natural Language Processing, AI Agent, Foundation Model

- DeepSeek OCR - Plus qu’un OCR - YouTube - Image Generation, Natural Language Processing