Type: Web Article Original link: https://www.krupadave.com/articles/everything-about-transformers?x=v3 Publication date: 2024-01-15

Résumé #

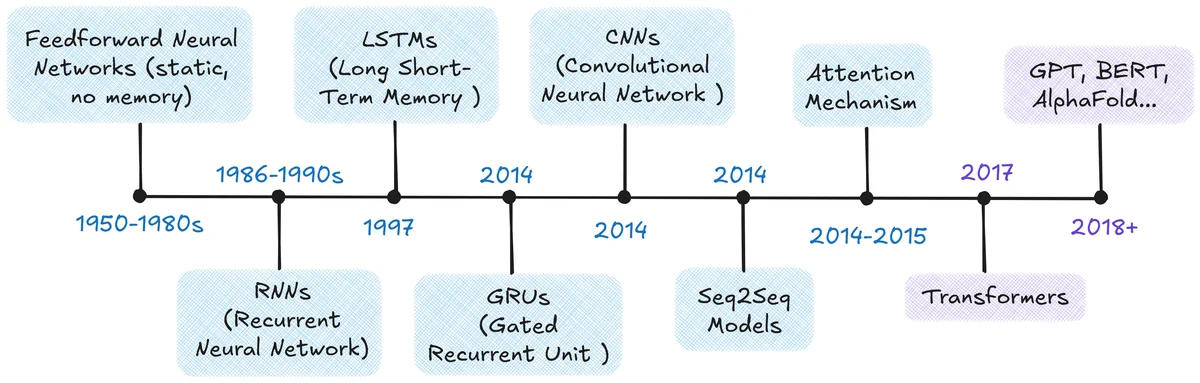

QUOI - Cet article traite de l’histoire et du fonctionnement de l’architecture des transformateurs, un modèle d’apprentissage profond fondamental pour le traitement du langage naturel (NLP). Il fournit une explication visuelle et intuitive de l’évolution des modèles de langage, de l’utilisation des réseaux de neurones récurrents (RNN) aux transformateurs modernes.

POURQUOI - Il est pertinent pour le business AI car les transformateurs sont à la base de nombreux modèles de NLP avancés, comme BERT et GPT. Comprendre leur fonctionnement et leur évolution est crucial pour développer de nouvelles solutions AI compétitives.

QUI - L’auteur est Krupa Dave, un expert dans le domaine de l’IA. L’article est publié sur le site personnel de Dave, qui s’adresse à un public technique intéressé par l’IA et le machine learning.

OÙ - Il se positionne sur le marché de l’éducation technique et de la vulgarisation scientifique dans le domaine de l’IA. Il est utile pour les professionnels et les chercheurs qui souhaitent approfondir leur compréhension des transformateurs.

QUAND - L’article a été publié le 15 janvier 2024, reflétant les connaissances actuelles et les tendances récentes dans le domaine de l’IA.

IMPACT COMMERCIAL:

- Opportunités: Il fournit une base solide pour le développement de nouveaux modèles de NLP, améliorant l’expertise interne sur l’architecture des transformateurs.

- Risques: Il ne représente pas un risque direct, mais ignorer les innovations décrites pourrait entraîner un retard concurrentiel.

- Intégration: Il peut être utilisé pour former l’équipe technique, améliorant la capacité d’innovation et de développement de nouveaux produits AI.

RÉSUMÉ TECHNIQUE:

- Technologie principale: L’article discute de l’architecture des transformateurs, y compris les encodeurs, les décodeurs, les mécanismes d’attention (self-attention, cross-attention, masked self-attention, multi-head attention), les réseaux feed-forward, la normalisation des couches, le codage positionnel et les connexions résiduelles.

- Scalabilité et limites architecturales: Les transformateurs sont connus pour leur capacité à s’évoluer efficacement, permettant le traitement de séquences de données en parallèle. Cependant, ils nécessitent des ressources informatiques significatives.

- Différenciateurs techniques clés: L’utilisation de l’attention comme mécanisme principal pour le traitement des séquences de données, permettant une plus grande flexibilité et précision par rapport aux modèles précédents.

Cas d’utilisation #

- Private AI Stack: Intégration dans des pipelines propriétaires

- Client Solutions: Mise en œuvre pour des projets clients

- Strategic Intelligence: Entrée pour la feuille de route technologique

- Competitive Analysis: Surveillance de l’écosystème AI

Ressources #

Liens Originaux #

- Everything About Transformers - Lien original

Article signalé et sélectionné par l’équipe Human Technology eXcellence élaboré via l’intelligence artificielle (dans ce cas avec LLM HTX-EU-Mistral3.1Small) le 2025-10-31 07:33 Source originale: https://www.krupadave.com/articles/everything-about-transformers?x=v3

Articles Correlés #

- Requests for Startups | Y Combinator - Tech

- A foundation model to predict and capture human cognition | Nature - Go, Foundation Model, Natural Language Processing

- Syllabus - Tech

Articles Connexes #

- Un modèle de fondation pour prédire et capturer la cognition humaine | Nature - Go, Foundation Model, Natural Language Processing

- Agents de Modèles de Langage de Grande Taille CS294/194-196 | Agents de Modèles de Langage de Grande Taille CS 194/294-196 - AI Agent, Foundation Model, LLM

- Le MCP dévore le monde—et il est là pour rester - Natural Language Processing, AI, Foundation Model