Type: GitHub Repository

Original link: https://github.com/jolibrain/colette/tree/main

Publication date: 2025-09-04

Résumé #

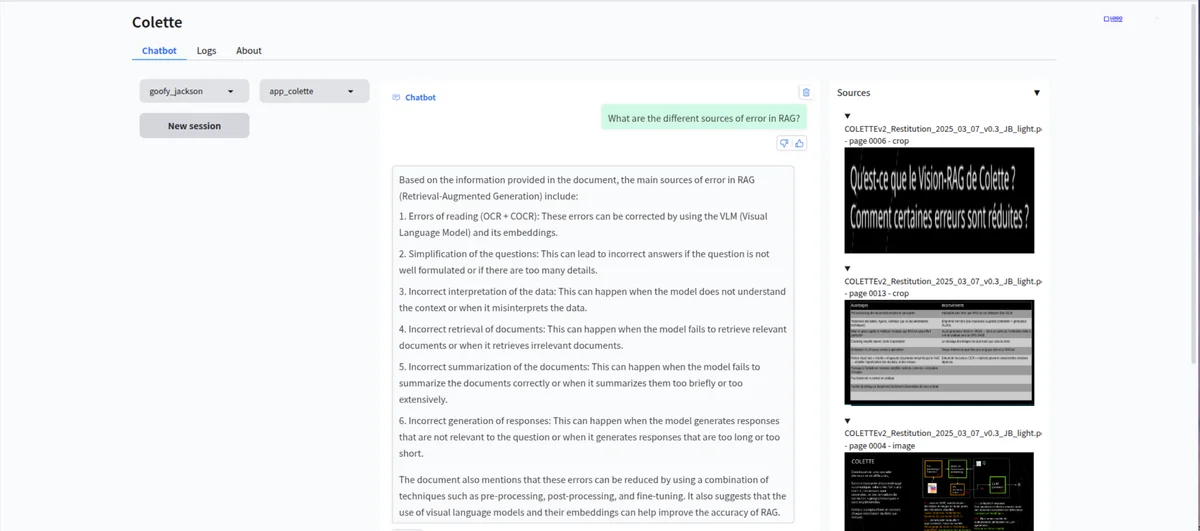

QUOI - Colette est un logiciel open-source pour le Retrieval-Augmented Generation (RAG) et le serving de Large Language Models (LLM). Il permet de rechercher et d’interagir localement avec des documents techniques de tout type, y compris des éléments visuels comme des images et des schémas.

POURQUOI - Il est pertinent pour le business AI car il permet de gérer des documents sensibles sans avoir à les envoyer à des API externes, garantissant ainsi sécurité et confidentialité. Il résout le problème d’extraction d’informations à partir de documents complexes et multimodaux.

QUI - Les principaux acteurs sont Jolibrain (développeur principal), CNES et Airbus (co-financeurs). La communauté est encore petite mais en croissance.

OÙ - Il se positionne sur le marché des solutions RAG et LLM, en se concentrant sur les documents techniques et multimodaux. Il fait partie de l’écosystème open-source AI.

QUAND - C’est un projet relativement nouveau mais déjà fonctionnel, avec un potentiel de croissance. La tendance temporelle montre un intérêt croissant, comme l’indiquent les étoiles et les fork sur GitHub.

IMPACT COMMERCIAL:

- Opportunités: Intégration avec des documents d’entreprise sensibles pour améliorer la recherche et l’interaction sans risque de fuite. Possibilité d’offrir des solutions personnalisées pour les clients ayant besoin de gérer des documents multimodaux.

- Risques: Concurrence avec des solutions propriétaires plus établies. Nécessité d’investissements pour maintenir et mettre à jour le logiciel.

- Intégration: Peut être intégré dans la pile existante via Docker, facilitant le déploiement et l’utilisation.

RÉSUMÉ TECHNIQUE:

- Technologies principales: HTML, Docker, Python, Vision Language Models (VLM), Document Screenshot Embedding, ColPali retrievers.

- Scalabilité: Nécessite un matériel robuste (GPU >= 24GB, RAM >= 16GB, Disque >= 50GB). La scalabilité dépend de la capacité à gérer de grands volumes de documents multimodaux.

- Différenciateurs techniques: Vision-RAG (V-RAG) pour l’analyse de documents comme des images, support multimodal, intégration avec des diffuseurs pour la génération d’images.

Cas d’utilisation #

- Private AI Stack: Intégration dans des pipelines propriétaires

- Solutions Client: Mise en œuvre pour des projets clients

- Accélération du Développement: Réduction du time-to-market des projets

- Intelligence Stratégique: Entrées pour la roadmap technologique

- Analyse Concurrentielle: Surveillance de l’écosystème AI

Ressources #

Liens Originaux #

- Colette - Lien original

Article signalé et sélectionné par l’équipe Human Technology eXcellence élaboré via intelligence artificielle (dans ce cas avec LLM HTX-EU-Mistral3.1Small) le 2025-09-04 19:37 Source originale: https://github.com/jolibrain/colette/tree/main

Articles Associés #

- DyG-RAG: Dynamic Graph Retrieval-Augmented Generation with Event-Centric Reasoning - Open Source

- PageIndex: Document Index for Reasoning-based RAG - Open Source

- dots.ocr: Multilingual Document Layout Parsing in a Single Vision-Language Model - Foundation Model, LLM, Python

Articles Connexes #

- dots.ocr : Analyse de la mise en page de documents multilingues dans un seul modèle vision-langage - Foundation Model, LLM, Python

- Dauphin : Analyse d’Images de Documents via des Invites d’Ancrage Hétérogènes - Open Source, Image Generation

- PaddleOCR - Open Source, DevOps, Python